El programa busca desarrollar tecnologías de IA capaces de ayudar a los humanos a realizar tareas complejas, ampliar sus habilidades y reducir errores.

El programa busca desarrollar tecnologías de IA capaces de ayudar a los humanos a realizar tareas complejas, ampliar sus habilidades y reducir errores.

Aumentar los conocimientos, la productividad y la eficiencia de los trabajadores ha sido una búsqueda aparentemente interminable tanto para los militares como para las empresas comerciales.

En la actualidad, se espera que el personal militar realice un número cada vez mayor de tareas complejas, al tiempo que interactúa con máquinas y plataformas cada vez más sofisticadas. Los asistentes habilitados por la inteligencia artificial (IA) tienen el potencial de ayudar a los usuarios en sus esfuerzos por ampliar sus habilidades y aumentar su productividad. Sin embargo, los asistentes virtuales actuales no están diseñados para proporcionar niveles avanzados de asistencia ni para compartir conocimientos en tiempo real.

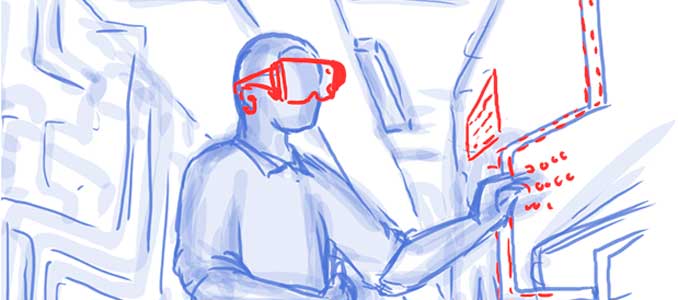

«En un futuro no muy lejano, podemos imaginarnos a los militares con una serie de sensores encima en cualquier momento, un micrófono, una cámara montada en la cabeza, y pantallas como auriculares de realidad aumentada (AR)», dijo el Dr. Bruce Draper, un director de programa en la Oficina de Innovación de la Información (I2O) de DARPA. «Estas plataformas de sensores generan toneladas de datos sobre lo que el usuario ve y oye, mientras que los cascos de AR proporcionan mecanismos de retroalimentación para mostrar y compartir información o instrucciones.

Lo que necesitamos en medio es un asistente que pueda reconocer lo que estás haciendo al empezar una tarea, que tenga los conocimientos necesarios para llevarla a cabo, que pueda guiarte paso a paso y que te avise de cualquier error que estés cometiendo.»

DARPA ha creado el programa Perceptually-enabled Task Guidance (PTG) para explorar el desarrollo de métodos, técnicas y tecnología para asistentes de IA capaces de ayudar a los usuarios a realizar tareas físicas complejas. El objetivo es desarrollar asistentes virtuales de «guía de tareas» que puedan proporcionar información visual y sonora justo a tiempo para ayudar a los usuarios humanos a ampliar sus habilidades y minimizar sus errores o equivocaciones. Para desarrollar estas tecnologías, el PTG busca explotar los recientes avances en el aprendizaje profundo para el análisis de vídeo y del habla, el razonamiento automatizado para la supervisión de tareas y/o planes, y la realidad aumentada para las interfaces humano-ordenador.

«Cada vez más buscamos desarrollar tecnologías que conviertan a la IA en un verdadero socio colaborador de los humanos», dijo Draper. «El desarrollo de asistentes virtuales que puedan proporcionar una ayuda sustancial a los usuarios humanos a medida que completan las tareas requerirá avances a través de una serie de áreas de enfoque de la tecnología de aprendizaje automático e IA, incluyendo la adquisición de conocimientos y el razonamiento.»

Para lograr sus objetivos, el PTG se divide en dos áreas de investigación principales. La primera se centra en la investigación fundamental para abordar un conjunto de problemas interconectados: la transferencia de conocimientos, la base perceptiva, la atención perceptiva y el modelado del usuario. La segunda se centra en las demostraciones integradas de los resultados de la investigación fundamental en escenarios de uso militarmente relevantes. En concreto, el programa explorará cómo los asistentes de orientación de tareas podrían ayudar en la reparación mecánica, la medicina del campo de batalla y/o la orientación de pilotos.

Para el programa, serán fundamentales la exploración y el desarrollo de nuevos enfoques de tecnologías integradas que aborden cuatro retos técnicos específicos. El primero es la transferencia de conocimientos. Los asistentes virtuales de tareas tendrán que ser capaces de adquirir automáticamente el conocimiento de la tarea a partir de las instrucciones destinadas a los humanos, incluidas las listas de comprobación, los manuales ilustrados y los vídeos de formación.

El segundo problema es el de la base perceptiva. Los asistentes tienen que ser capaces de alinear sus entradas perceptivas, incluidos los objetos, los ajustes, las acciones, los sonidos y las palabras, con los términos que el asistente tiene que emplear para describir y modelar las tareas a sus usuarios humanos, de modo que las observaciones puedan asignarse a su conocimiento de la tarea. La atención perceptiva es la tercera área de problemas. Los asistentes deben ser capaces de prestar atención a las entradas perceptivas que son relevantes para las tareas actuales, ignorando al mismo tiempo los estímulos extraños. También deben ser capaces de responder a eventos inesperados, pero relevantes, que pueden alterar los objetivos del usuario o sugerir una nueva tarea.

La última área de problemas es el modelado del usuario. Los asistentes PTG deben ser capaces de determinar cuánta información compartir con un usuario y cuándo hacerlo. Para ello es necesario desarrollar e integrar un modelo epistémico de lo que sabe el usuario, un modelo físico de lo que está haciendo y un modelo de sus estados atencionales y emocionales. Dado que estos cuatro problemas no son independientes entre sí, el PTG pretende buscar enfoques y soluciones integradas que aborden colectivamente las cuatro áreas de desafío.

El desarrollo de agentes con IA no es un terreno nuevo para DARPA. Además de invertir en el avance de la tecnología de IA durante más de 50 años, DARPA financió la creación de las tecnologías que subyacen a los actuales asistentes virtuales, como Siri. A principios de la década de 2000, DARPA lanzó el programa Personalized Assistant that Learns (PAL). En el marco de PAL, los investigadores crearon sistemas de computación cognitiva para que la toma de decisiones de los militares fuera más eficiente y eficaz en múltiples niveles de mando.

El anuncio del PTG se publicará próximamente en el sitio web del Sistema de Gestión de Adjudicaciones (SAM) en https://beta.sam.gov/.

Fte. DARPA News

Sé el primero en comentar